Home > Testcenter > Dallmeier DOMERA® RDF6800DN

intelligent, vielseitig, bildstark mit Deep AI Objektklassifizierung

AUFLÖSUNG

8,3 MP (3840 x 2160)

OBJEKTIV

4,5 – 9,7 mm

SINGLE-SENSOR

1/1,7″ CMOS

Die Dallmeier DOMERA® RDF6800DN ist mit einem 1/1,7-Zoll-CMOS ausgestattet und besticht mit einer 16:9 4K UHD Auflösung von 3840 × 2160 Pixeln. Damit ergibt sich eine maximale Sensorpixelanzahl von 8,3 MP.

Die DOMERA® RDF6800DN hat ein motorgetriebene P-Iris Objektiv und gibt es in zwei unterschiedlichen Brennweitenvarianten. So gibt es eine RDF6800DN.008298.401 mit einem 4,5 bis 9,7 mm Varifokal-Objektiv (Blendenzahl F1.3) und eine RDF6800DN.008298.402 ausgestattet mit einem 12 bis 40 mm ebenfalls Varifokal-Objektiv und einer Blendenzahl F1.8.

Der Betrachtungswinkel beträgt bei der 4,5 - 9,7 mm Variante bei horizontal 47º - 110° und vertikal bei 26,2° bis 55,4°. Bei der Kameravariante mit dem Objektiv 12 - 40 mm reicht der horizontale Betrachtungswinkel von 12,1° - 35,2°, der vertikale Betrachtungswinkel reicht bei diesem Kameratyp von 6,8° - 19,3°.

Die 8,3 MP DOMERA® Kamera von Dallmeier schafft mit dem 4,5 - 9,7 mm Objektiv entsprechend der DIN EN 62676‑4, die Qualität Erkennen [125 Px/m] auf eine maximale Entfernung von 36 Meter und eine maximale Objektbreite von bis zu 31 Meter.

Die Kamera mit dem 12 - 40 mm Objektiv schafft Erkennen [125 Px/m] auf eine maximale Entfernung von 141 Meter und eine maximale Objektbreite von bis zu ebenfalls 31 Meter.

Die Bildrate beträgt bei maximaler 4K Auflösung bis zu 30 fps, Bilder pro Sekunde.

Eine Systemintegration in nicht schnittstellenunterstützende Anlagen kann über die ONVIF®- Profile M, S und T erfolgen.

Die Kamera verfügt über eine motorische 3-Achsenverstellung (RPoD / Remote Positioning Dome). Mit diesem Assistenten kann die Kameraansicht nach der Installation korrekt eingestellt bzw. im Nachhinein verändert werden.

Zur Speicherplatz- und Bandbreiten-Einsparung beherrscht die Dallmeier DOMERA® RDF6800DN neben der Videokomprimierung H.264 auch High Efficiency Video Coding, kurz H.265. Für die Spannungsversorgung wird nach dem PoE-Standard IEEE 802.3af ein Anschluss der Klasse 0 (PoE Class 0) für eine maximale Leistungsaufnahme von 12 W benötigt.

TEST

Dallmeier DOMERA® RDF6800DN

Getestet wurde die Dallmeier DOMERA® RDF6800DN mit einer Brennweiten von 4,5 - 9,7 mm inklusive DOMERA® Wall Bracket

VERPACKUNG

Die RDF6800DN wie das DOMERA® Wall Bracket (Wandhalterung) befinden sich bei Lieferung jeweils in einem Karton auf dessen Außenseite die Kamera bzw. die Wandhalterung abgebildet sind. Der Kamerakartonverschluss wird durch ein Schutzsiegel gesichert. Im Kartoninneren wird die Kamera wie die Wandhalterung durch Kartonschalen geschützt.

Zum Lieferumfang gehören neben einer allgemeinen Installationsanleitung und den Informationen bezüglich der Garantie auch umfangreiches Montagezubehör.

KAMERAMODUL RDF6800DN

Bei der Dallmeier DOMERA® RDF6800DN 4,5-9,7 mm handelt es sich um eine motorgetriebenen 3-achenverstellbare Single-Sensor Dome Kamera. In der Verpackung ist das Kameramodul als unter Putz Einbauvariante untergebracht. Soll die Kamera Aufputz montiert werden ist zusätzlich ein Adapter erforderlich.

Zur Verfügung steht das Einbaugehäuse DOMERA® Surface Mount Adapter für die einfache Aufputz Montage, der multifunktionale Halter DOMERA® Wall Bracket sowie der Halter DOMERA® Wall Bracket with Speaker bei Nutzung der RDF6800DN Kamera als Gegensprechanlage.

Das Kameramodul der RDF6800DN misst einen Durchmesser von 171 mm und hat eine Gesamthöhe von 133 mm, das Gewicht des Kameramoduls wird im Datenblatt mit ca. 1,2 kg angegeben. Das Kameramodul besteht aus Aluminium, die Dome-Kuppel aus Polycarbonat.

Ein öffnen der Dome Kuppel ist für die Installation und Justage nicht mehr erforderlich. Die Objektiv Positionierung der RDF6800DN kann dank, motorischer 3-Achsen Verstellung, bequem über den Operatorbedienplatz erfolgen.

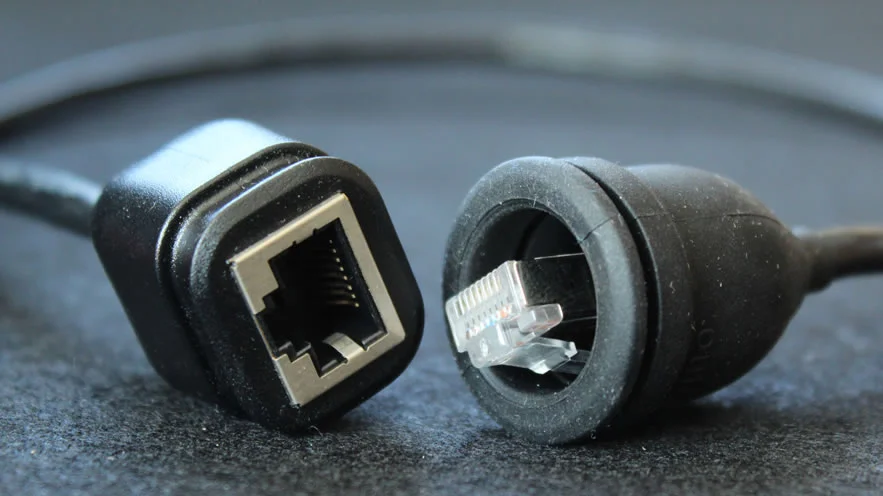

Das Kameramodul kann über das im Lieferumfang enthaltene RJ45-Adapterkabel versorgt werden. Dies ist besonders praktisch bei Verwendung des multifunktionalen Halters, DOMERA® Wall Bracket. Ansonsten kann das DOMERA®-Kameramodul in der Unterputz-Einbau-Variante auch direkt mit einem bauseits bereitgestellten z.B. Cat 7a Netzwerkkabel versorgt werden.

Das Kameramodul der RDF6800DN besitzt einen internen lokalen 50 MB RAM-Speicher für die Zwischenspeicherung von Daten bei unterbrochener LAN-Verbindung. Optional ist eine Speichererweiterung mittels einer microSDXC 32 bzw. 64 GB Speicherkarte möglich. Dabei werden Geschwindigkeitsklassen nach Class 10 wie UHS-I unterstützt.

UHS steht für Ultra High Speed und erlaubt über das interne UHS-BUS-System Datenübertragungsraten von bis zu 100 MB/s. Class 10 definiert dabei den Standard für deklarierte microSDXC-Speicherkarten auf die Mindestgeschwindigkeit von 10 MB/s, 10 Megabyte pro Sekunde. Der Speicherkarten-Slot befindet sich auf der Oberseite des Kameramoduls unter einer Gummiabdeckung mit dem Aufdruck SD.

Die RDF6800DN-Kamera besitzt 5 halbdiskrete 850 nm IR-LEDs sowie 5 Weißlicht-Leuchtdioden, welche außerhalb der Polycarbonat-Kuppel im gegenseitigen Abstand von 60° angeordnet sind. Über das Kamera-Webinterface kann die Intensität dieser LEDs individuell eigestellt werden. Laut Datenblatt reicht die IR-Zusatzbeleuchtung der Dallmeier DOMERA® RDF6800DN bis zu einer Distanz von etwa 30 Meter.

Der Stoßfestigkeitsgrad der Kamera beträgt IK10. Dies bedeutet, dass die Kamera eine Schlagenergie von 20 Joule standhält, dies entspricht der freigesetzten Energie eines Gewichts von 5 kg aus einer Fallhöhe von 40 cm.

Das RDF6800DN Kameramodul weist eine Schutzart IP55 beim Deckeneinbau oder in Verbindung mit dem DOMERA® Surface Mount Adapter auf. Die Schutzart IP66 wird erreicht in Verbindung mit der speziellen Dallmeier Wandhalterung, DOMERA® Wall Bracket.

KAMERAHALTERUNG

Wie bereits erwähnt ist die Dallmeier DOMERA® RDF6800DN unmittelbar für die Decken-Unterputzmontage vorbereitet. Für eine Decken-Aufputzmontage wird der DOMERA® Surface Mount Adapter benötigt. Soll die Kamera an der Wand montiert werden, kann entweder der zuvor genannte Adapter zum Einsatz kommen oder aber die DOMERA®-Wandhalterung, DOMERA® Wall Bracket mit oder ohne Lautsprecher.

INBETRIEBNAHME + SOFTWARE + WEBINTERFACE

Standard-IP-Adresse

- Voreingestellte IP-Adresse: Die ab Werk eingestellte Standard-IP-Adresse für eine Dallmeier Single-Sensor-Kamera ist 192.168.2.28.

- Änderung der Netzwerkeinstellungen: Benutzer können die IP-Adresse, Subnetzmaske und Gateway-Adressierung des Geräts mit der Client-Software Dallmeier Device Manager ändern.

Herstellung der Verbindung

- Vorbereitung der Netzwerkverbindung: Zunächst muss sichergestellt werden, dass der Client-PC und der Webbrowser eine Verbindung zum Gerät über das Ethernet-Netzwerk herstellen können. Bei Bedarf sollte die Unterstützung der Netzwerkadministration in Anspruch genommen werden.

- Start des Webbrowsers: Der nächste Schritt ist das Öffnen eines Webbrowsers auf dem Client-PC.

- Eingabe der IP-Adresse: Im Webbrowser muss die IP-Adresse des Dallmeier Geräts in die Adresszeile eingegeben werden.

- Bestätigung der Eingabe: Nach Eingabe der IP-Adresse muss diese bestätigt werden, um die Verbindung herzustellen.

Nach der Verbindungsherstellung

- Sicherheitsvorkehrungen: Aus Sicherheitsgründen wird nach erfolgreicher Verbindung zum Gerät und vor dem ersten Login ein Dialog für die Erstanmeldung angezeigt.

WEBINTERFACE ÜBERBLICK

1. Allgemeine Einstellungen

Spracheinstellungen: Der Abschnitt erklärt, wie die Spracheinstellungen im System vorgenommen werden können.

2. Bildkonfiguration

Voreinstellungen und Bildoptimierung: Beschreibt die verschiedenen Voreinstellungen für die Bildqualität und erklärt, wie Anpassungen für eine optimale Bildwiedergabe vorgenommen werden.

Belichtungssteuerung: Dieser Teil fokussiert sich auf die verschiedenen Optionen zur Steuerung der Belichtung, um die beste Bildqualität in verschiedenen Beleuchtungssituationen zu erreichen.

Tag/Nacht-Modus: Erklärt, wie das System zwischen Tag- und Nachtmodus umschaltet und welche Einstellungen dafür relevant sind.

Private Zonen und Text-Overlay: Hier wird beschrieben, wie private Bereiche definiert und wie Textinformationen auf dem Bild dargestellt werden können.

3. Objektivsteuerung (RPoD)

Dieser Abschnitt beschäftigt sich mit der Steuerung des Objektivs, einschließlich der Justierung und Kalibrierung.

4. Videoeinstellungen

Sensoreinstellungen: Hier werden die Einstellungen des Bildsensors behandelt, um die Bildqualität zu optimieren.

Stream-/Encodereinstellungen: Dieser Abschnitt geht auf die Einstellungen für das Streaming und die Kodierung von Videos ein.

5. Audioeinstellungen

Audioeingang und -ausgang: Beschreibt die Konfiguration von Audioeingängen und Audioausgängen.

Lautstärke und Audio-Codec: Hier wird erläutert, wie die Lautstärke eingestellt und verschiedene Audio-Codecs konfiguriert werden können.

6. Datum & Uhrzeit

Manuelle Konfiguration und Zeitserver-Einstellungen: Dieser Abschnitt beschreibt, wie Datum und Uhrzeit manuell eingestellt oder über einen Zeitserver synchronisiert werden können.

7. Netzwerk

Grundlegende Einstellungen bis Keystore: Von der Konfiguration grundlegender Netzwerkeinstellungen bis hin zur Einrichtung von Bandbreitenbegrenzungen, Streaming-Optionen, Quality of Service, SNMP, Netzwerk-Diensten und der Verwaltung von Sicherheitsschlüsseln werden alle relevanten Aspekte abgedeckt.

8. Schnittstellen

Relais-Ausgänge und Kontakt-Eingänge: Erklärt die Verwendung von Schnittstellen für Relais-Ausgänge und Kontakt-Eingänge.

9. EdgeStorage

Dieser Teil befasst sich mit der Speicherung von Daten am Rand des Netzwerks, also direkt auf der Videoüberwachungskamera.

10. Ereignisverwaltung

Regeln, Bedingungen und Aktionen: Beschreibt, wie Ereignisse verwaltet, Regeln definiert und Bedingungen sowie Aktionen festgelegt werden.

Regelhistorie und Empfänger: Erklärt, wie die Historie von Regeln eingesehen und Empfänger für Benachrichtigungen konfiguriert werden können.

11. Dateneinblendung

Dauer, Position und Felder: Dieser Abschnitt behandelt die Einblendung von Daten auf dem Bildschirm, einschließlich der Dauer der Einblendung, der Positionierung und der Felderauswahl.

12. Edge Analytics & AI Apps

Von VCA Motion Detection bis Objekte & Ereignisse: Hier werden verschiedene Analytik- und KI-Anwendungen behandelt, die Bewegungserkennung, Objekterkennung, Intrusion Detection, Line Crossing, Loitering und Tamper Detection umfassen.

13. Benutzer & Rechte

Benutzerverwaltung bis anonymer Zugriff: Dieser Teil beschreibt, wie Benutzer verwaltet, Gruppen eingerichtet und Rechte verteilt werden, einschließlich der Konfiguration für anonymen Zugriff.

14. Service

Konfigurationsdatei bis Lizenzen: Enthält Informationen über den Export und Import von Konfigurationsdateien, den Systemstatus, die Durchführung von Firmwareupdates und die Verwaltung von Service-Lizenzen.

15. Informationen

Allgemeine Informationen bis Netzwerkverbindungen: Bietet allgemeine Informationen über das Gerät, den Gerätestatus, Informationen zu Drittanbieterkomponenten und Netzwerkverbindungen.

▶ Eine ausführliche Anleitung zum Webinterface findet sich unter: Webinterface Dallmeier DOMERA® RDF6800DN

Vergleich mit Standard Full HD Kamera

[ERKENNEN 125 Px/m]

Erklärung prozentuale Darstellung: Die maximale Distanz für ERKENNEN entspricht 100 %. Alle anderen Werte werden prozentual daran ausgerichtet.

Beispiel: max. ERKENNEN = 36 m = 100 %. Min. ERKENNEN = 31 m dies entspricht 100 % *31 m / 36 m = 86 %

[ERKENNEN 125 Px/m]

Erklärung prozentuale Darstellung: Die maximale Distanz für ERKENNEN entspricht 100 %. Alle anderen Werte werden prozentual daran ausgerichtet.

Beispiel: max. ERKENNEN = 141 m = 100 %. Min. ERKENNEN = 31 m dies entspricht 100 % *31 m / 141 m = 22 %

[IDENTIFIZIEREN 250 Px/m]

Erklärung prozentuale Darstellung: Die maximale Distanz für IDENTIFIZIEREN entspricht 100 %. Alle anderen Werte werden prozentual daran ausgerichtet.

Beispiel: max. IDENTIFIZIEREN = 17 m = 100 %. Min. IDENTIFIZIEREN = 15 m dies entspricht 100 % *15 m / 17 m = 88 %

[IDENTIFIZIEREN 250 Px/m]

Erklärung prozentuale Darstellung: Die maximale Distanz für IDENTIFIZIEREN entspricht 100 %. Alle anderen Werte werden prozentual daran ausgerichtet.

Beispiel: max. IDENTIFIZIEREN = 68 m = 100 %. Min. IDENTIFIZIEREN = 15 m dies entspricht 100 % *15 m / 68 m = 22 %

für Hersteller

Sie möchten Ihr Produkt auf CCTV-check listen?

Technische Daten

- Auflösung max.

- Sensorpixelanzahl

- Objektiv Brennweite

- Objektiv Blendenbereich

- Blendensteuerung

- Zoom / Fokussierung

- Bildsensor

- Bildrate

- Videokompression

- Minimale Ausleuchtung

- Spannungsversorgung

- Spannungsversorgung

- PoE-Standard

- Unterstützte Protokolle

- Ethernet

- Interoperabilität

- IK-Stoßfestigkeitsgrad

- IP Schutzklasse

- Besonderheiten

- Materialien

- Abmessungen

- Gewicht

Dallmeier

- 3840 x 2160

- 8,3 MP

- 4,5 bis 9,7 mm

- F1.3 – Geschlossen

- P-Iris (motorgetrieben)

- motorgetrieben

- 1/1,7" CMOS

- 3840 x 2160 4K bis zu 25 Bilder/s

- H.265, H.264

- Modelle mit IR Beleuchtung: 0 lux (IR LED ON)

Modelle ohne IR Beleuchtung: < 0,05 lux (F1.4, AGC ON) - PoE (Class 0)

24 V DC - 48 V DC ±5% (mit DOMERA® Breakout Cable) - PoE max. 12 W

- IEEE 802.3af

- IPv4 (ARP, ICMP, IGMPv2/IGMPv3), UDP, TCP, LLDP, CDP (v1,v2), DSCP (QoS), DNS, DHCP, NTP, HTTP/HTTPS, RTSP/RTP/RTCP, SNMP (v1, v2c, v3), MQTT

Ethernet-Protokolle in Vorbereitung: IPv6 (NDP, ICMPv6, MLDv1/MLDv2, SLAAC, RDNSS), UDPv6, TCPv6, DNSv6, DHCPv6, LDAP - 10BASE-T-/100BASE-TX

- DaVid, DaVidS, ONVIF® Profile M, ONVIF® Profile S, ONVIF® Profile T, SNMP (v1, v2c, v3)

- IK10 (bis zu 20 Joule)

- IP55 (Deckeneinbau oder in Verbindung mit DOMERA® Surface Mount Adapter)

IP66 (in Verbindung mit DOMERA® Wall Bracket) - Umgebungslichtsensor, Lagesensor, Mikrofon integriert in DOMERA® Dual Matrix LED Ring, lokaler Speicher 50 MB RAM-Speicher, Justierung über 3-Achsen (Remote Positioning über das Netzwerk)

- Kameramodul und Kamerasockel: Aluminium

Kuppel: Polycarbonat - Durchmesser ca. 171 × H 133 mm (H 137 mit Aufputzadapter)

Kamera Gesamthöhe: ca. 137 mm - ca. 1,2 kg (1,4 kg mit Aufputzadapter)

NUTZUNG | HAFTUNG

Trotz sorgfältiger Kontrolle übernehmen wir keine Gewähr für die Richtigkeit und Vollständigkeit der Inhalte.

Nikola Tesla: Pionier der Elektrotechnik

Nikola Tesla erblickte am 10. Juli 1856 im beschaulichen Dorf Smiljan in Zentralkroatien das Licht der Welt. Seine Familie war serbischer Herkunft und tief religiös verwurzelt. Sein Vater, Milutin Tesla, diente der Gemeinschaft als serbisch-orthodoxer Priester, was das familiäre Leben stark prägte. Trotz ihrer fehlenden formellen Bildung im Lesen und Schreiben verfügte seine Mutter, Georgina Tesla, über ein beeindruckendes Gedächtnis.

Sie konnte zahlreiche Bibelstellen und literarische Verse auswendig vortragen, was Nikola Tesla in seiner Jugend zweifellos beeinflusste. Diese häusliche Umgebung, geprägt von geistiger Auseinandersetzung und dem Vorbild einer intuitiven und kreativen Mutter, legte den Grundstein für Teslas spätere Neigung zu tiefem Denken und innovativer Problemlösung, die ihn zu einem der größten Erfinder aller Zeiten machen sollte.

Nikola Tesla gilt als einer der innovativsten und visionärsten Erfinder der Geschichte. Während seines Lebens meldete Tesla über 300 Patente an, die in vielerlei Hinsicht die Grundlagen der heutigen elektrischen Systeme und Technologien bildeten. Diese Patente umfassen ein breites Spektrum an Technologien, darunter Wechselstromgeneratoren, Transformatoren, Motoren, drahtlose Kommunikationstechnik und vieles mehr, die alle zusammen seine Rolle als einer der Hauptpioniere der elektrischen Revolution festigen.

Inhaltsverzeichnis

Nikola Tesla Kindheit

Tesla wuchs in einem Agrarland auf. Eine Dampflokomotive sah er erst, als er schon ein Jüngling war, folglich konnte seine technische Begabung nicht ein Produkt der Umgebung sein. Schon in seiner frühen Kindheit zeigte sich Nikola Tesla als außergewöhnlicher Denker, was ihn oft von seinen Altersgenossen isolierte und ihm das Knüpfen von Freundschaften erschwerte. Seine einzigartige Denkweise machte ihn zu einem Einzelgänger, der sich in der Welt der Ideen wohler fühlte als in der Spielplatzdynamik. Ein prägender Moment in seiner Kindheit war der tragische Unfalltod seines geliebten älteren Bruders Dane.

Dieses Ereignis hinterließ eine tiefe Narbe in dem jungen Nikola und trieb ihn dazu, Trost und Ablenkung in der Welt der Technik zu suchen. Bereits im zarten Alter von fünf Jahren begann er, mit verschiedenen technischen Apparaturen zu experimentieren. Diese frühen Experimente waren nicht nur ein Weg, seinen Schmerz zu verarbeiten, sondern legten auch den Grundstein für seine späteren bahnbrechenden Erfindungen.

Wir sind nur Räder im Getriebe des Universums und es ist eine unvermeidbare Konsequenz der herrschenden Gesetze, dass der Pionier, der seiner Zeit weit voraus ist, Leid und Enttäuschungen erleiden und mit dem größeren Lohn, der ihm von der Nachwelt zuteilwird, zufrieden sein muss.

NIKOLA TESLA

Technischen Hochschule Graz

Nach Abschluss seiner Schulausbildung zog Nikola Tesla nach Graz, um an der Kaiserlich-Königlichen Technischen Hochschule zu studieren. Dort belegte er im ersten Jahr verschiedene Vorlesungen und entschied sich schließlich für ein Maschinenbaustudium. Allerdings brach er das Studium ab, ohne einen Abschluss zu erlangen, da er das Interesse an den Vorlesungen verlor und im dritten Studienjahr die Studiengebühren nicht mehr bezahlte, was 1877 zu seiner Exmatrikulation führte. Nach seiner Exmatrikulation zog Tesla nach Marburg an der Donau, wo er jedoch durch sein exzessives Nachtleben auffiel und schließlich von den örtlichen Behörden der Stadt verwiesen wurde. 1879 kehrte er in seinen Heimatort zurück und übernahm nach dem Tod seines Vaters kurzzeitig eine Stelle als Aushilfslehrer.

Nikola Tesla scheiterte auch beim zweiten Anlauf, sein Studium erfolgreich abzuschließen. Obwohl sein Onkel ihm die Möglichkeit und die finanziellen Mittel bot, an der Karls-Universität in Prag zu studieren, zahlte Tesla auch dort seine Studiengebühren nicht.

Continental Edison Company Paris

Nach dem wiederholten Abbruch seines Studiums an der Karls-Universität in Prag zog Nikola Tesla nach Budapest, wo er als Telegrafentechniker unter Tivadar Puskás arbeitete, einem ungarischen Erfinder, der eine hohe Position im internationalen Unternehmen von Thomas Edison innehatte. Puskás empfahl Tesla, nach Paris zu gehen und für die Continental Edison Company zu arbeiten, wo er mit elektrischen Installationen in öffentlichen Gebäuden betraut wurde. Während seiner Zeit in Paris begann Tesla intensiv mit der Konstruktion eines Wechselstrommotors zu experimentieren, stieß jedoch auf wenig Interesse bei seinen Kollegen.

Die Gegenwart gehört ihnen, doch die Zukunft, für die ich gearbeitet habe, gehört mir.

NIKOLA TESLA

New York

Nach seinen ersten beruflichen Erfahrungen in Paris fasste Nikola Tesla den entschlossenen Entschluss, sein Glück in den Vereinigten Staaten zu suchen. In der Hoffnung auf größere Chancen und die Möglichkeit, seine visionären Ideen zu verwirklichen, verkaufte Tesla seinen gesamten Besitz, um die Überfahrt nach New York zu finanzieren. Als er 1884 in New York ankam, war er mittellos, mit nicht viel mehr als einigen Empfehlungsschreiben in der Tasche.

Eine dieser Empfehlungen führte Tesla direkt zu Thomas Alva Edison, dessen Unternehmen, die Edison Machine Works, auf der Suche nach talentierten Ingenieuren war. Tesla wurde schnell eingestellt, da seine Fähigkeiten und sein Wissen über die Elektrizität beeindruckend waren. Seine Zeit bei Edison war jedoch von kurzer Dauer. Obwohl Tesla mit großem Eifer und Engagement arbeitete, traten bald signifikante Differenzen zwischen ihm und Thomas Alva Edison zutage. Der Hauptstreitpunkt lag in ihren grundlegend unterschiedlichen Ansichten zur elektrischen Energieversorgung: Während Edison ein Verfechter des Gleichstromsystems (DC) war, sah Tesla die zahlreichen wesentlichen Vorteile des Wechselstromsystems (AC).

Diese Meinungsverschiedenheiten führten schließlich dazu, dass Tesla das Unternehmen nach nur wenigen Monaten verließ. Trotz der kurzen und turbulenten Zeit bei Edison, war Teslas Aufenthalt in New York wegweisend für seine weitere Karriere. Er erkannte, dass er seine eigenen Wege gehen musste, um seine innovativen Ideen in die Praxis umzusetzen.

Die Erfahrung bei Edison stärkte Teslas Entschlossenheit, seine Ideen zum Wechselstrom zu verfolgen, was ihn letztlich dazu brachte, eigene Patente anzumelden und Partnerschaften mit Geschäftsleuten einzugehen, die seine Vision teilten. Diese Entscheidungen legten den Grundstein für seine späteren Erfolge, darunter die Entwicklung des Wechselstromsystems, das heute weltweit die Basis für die elektrische Energieversorgung bildet. Nikola Teslas Mut, sein altes Leben hinter sich zu lassen und in New York ganz von vorne anzufangen, war ein entscheidender Schritt auf seinem Weg, einer der größten Erfinder aller Zeiten zu werden.

Die meisten Menschen sind so in der Außenwelt versunken, dass sie für das, was in sich selbst abläuft, völlig blind sind.

NIKOLA TESLA

Tesla Electric Light and Manufacturing Company

Nach seiner Trennung von Edison fand sich Nikola Tesla in einer prekären finanziellen Lage wieder und musste sich zunächst mit Gelegenheitsjobs in verschiedenen technischen Betrieben über Wasser halten. Trotz dieser Rückschläge verlor Tesla nicht den Mut und gründete bald darauf sein eigenes Unternehmen, die Tesla Electric Light and Manufacturing Company. Tesla hoffte, durch seine innovative Firma den Durchbruch zu schaffen und seine zahlreichen Erfindungen und Ideen kommerziell zu verwerten. Doch der erhoffte Erfolg blieb aus. Die geschäftliche Unternehmung stürzte ihn tiefer in Schwierigkeiten, da er von seinen eigenen Geschäftspartnern betrogen wurde. Diese Erfahrungen waren zwar demoralisierend, aber sie stählten auch seinen Charakter und seinen Entschluss, seine technologischen Visionen weiterzuverfolgen, was ihn letztlich zu neuen Projekten führte.

Tesla Electric Company

Nach einem schwierigen Start und der unvermeidlichen Konkurserklärung seiner ersten Firma der Tesla Electric Light and Manufacturing Company sah sich Nikola Tesla mit einer ungewissen Zukunft konfrontiert. Doch das Schicksal sollte sich bald wenden, als er die Aufmerksamkeit von A. K. Brown, einem Manager der Western Union Company, auf sich zog. Brown erkannte Teslas ungeheures Potenzial und stellte ihm die finanziellen Mittel zur Verfügung, die er benötigte, um ein neues Unternehmen, die Tesla Electric Company, zu gründen.

In dieser neuen Phase seiner Karriere widmete sich Tesla der Entwicklung und Perfektionierung seines Wechselstromsystems, das auf einem rotierenden Magnetfeld basierte. Dieses bahnbrechende Konzept war ein entscheidender Durchbruch in der Elektrotechnik und bildete die Grundlage für moderne Elektrizitätsnetze. Im Gegensatz zu Edisons Gleichstromsystem, welches aufgrund hoher Verluste bei der Übertragung über längere Distanzen ineffizient war, ermöglichte Teslas Wechselstromsystem die effiziente Übertragung elektrischer Energie über weite Strecken. Diese Innovation löste viele technische Probleme der damaligen Zeit und machte Elektrizität für ein breiteres Spektrum von Anwendungen und größere geografische Bereiche zugänglich.

Teslas Arbeit führte schließlich zur Anmeldung mehrerer Patente, die seine Ideen zum Wechselstromsystem schützten. Das wohl bekannteste dieser Patente war das für den Wechselstrominduktionsmotor, der eine Schlüsselkomponente in der Nutzung von Wechselstrom darstellte. Diese Erfindung veränderte die Welt der Energieerzeugung und -verteilung grundlegend und markierte den Beginn der endgültigen Abkehr von Edisons Gleichstrom.

Die Anerkennung für Teslas revolutionäre Erfindungen kam schnell, und praktisch über Nacht wurde er zu einer Koryphäe in der Welt der Ingenieure und Wissenschaftler in den Vereinigten Staaten. Sein Erfolg führte auch zu einer Partnerschaft mit George Westinghouse, dessen Firma Westinghouse Electric, Nikola Tesla unterstützte um das Wechselstromsystem national zu etablieren – ein Unterfangen, das im "Stromkrieg" gegen Edison und seine Anhänger gipfelte.

Nikola Teslas Beitrag zur elektrischen Revolution war immens und seine Visionen und technischen Errungenschaften sind bis heute grundlegend für unsere moderne Elektrizitätsversorgung. Seine Fähigkeit, nach Rückschlägen immer wieder aufzustehen und seine Ideen weiterzuentwickeln, macht ihn zu einer der inspirierendsten Figuren in der Geschichte der Elektrotechnik.

Besuch der Heimat und Rückkehr nach New York

Nikola Tesla reiste zurück nach Paris. Nachdem er eine Zeit lang dort verbrachte und auch sein Heimatdorf in Kroatien besucht hatte, kehrte er im Spätsommer 1889 zurück nach New York. Dort mietete er sich ein Labor an der Grand Street, ein Ort, der bald zum Zentrum seiner fortlaufenden Experimente mit Wechselstromsystemen werden sollte. Dank der finanziellen Sicherheit, die ihm sein lukrativer Vertrag mit George Westinghouse bescherte, gönnte sich Tesla einen luxuriösen Lebensstil, der Aufenthalte in teuren Hotels einschloss.

In dieser Phase seines Lebens widmete sich Tesla nicht nur der Weiterentwicklung und Verfeinerung seiner Wechselstromtechnologien, sondern interessierte sich auch für die Verbesserung bestehender Erfindungen. Ein besonderer Fokus lag dabei auf Thomas Edisons Glühlampe. Tesla setzte es sich zum Ziel, eine effizientere Version der Glühlampe zu entwickeln, die weniger Strom verbrauchen sollte. Diese Periode war geprägt von intensiver Forschung und Kreativität, während Tesla seine Visionen weiter verfolgte und bestehende Technologien herausforderte, um die Grenzen des Möglichen in der elektrischen Beleuchtung und Energieübertragung zu erweitern.

Hochfrequenzströme

Im Laufe seiner bahnbrechenden Karriere gelang es Nikola Tesla, Hochfrequenzströme zu erzeugen, eine Entdeckung, die er 1890 der Öffentlichkeit vorstellte. Diese Arbeit stellte einen bedeutenden Fortschritt in der Elektrotechnik dar und eröffnete neue Möglichkeiten in der drahtlosen Kommunikation. Doch trotz des innovativen Potenzials dieser Entdeckung meldete Tesla seine Erfindung nicht zum Patent an. Diese Entscheidung sollte sich als kostspielig erweisen, denn ohne den rechtlichen Schutz eines Patents konnte Tesla die Früchte seiner Arbeit nicht voll ausschöpfen. In kürzester Zeit entstanden zahlreiche Nachahmungen seiner Technologie, die von anderen ohne Entschädigung oder Anerkennung für Tesla kommerzialisiert wurden.

Nikola Tesla und J. P. Morgan

Trotz dieser Rückschläge setzte Tesla seine Forschungen fort und blieb eine zentrale Figur in der wissenschaftlichen Gemeinschaft. Sein Ruf als innovativer Erfinder zog schließlich die Aufmerksamkeit von John Pierpont Morgan (J. P. Morgan), einem der einflussreichsten Finanziers seiner Zeit, auf sich. Im Jahr 1900 machte Morgan Tesla ein Angebot, das er nicht ablehnen konnte: Er sollte für 150.000 Dollar ein Radio bauen, das in der Lage war, transatlantische Signale zu senden. Dieses Projekt war nicht nur aufgrund seines hohen finanziellen Umfangs bedeutsam, sondern auch, weil es das Potenzial hatte, die Art und Weise, wie Informationen über weite Strecken übermittelt wurden, grundlegend zu verändern.

Mich beunruhigt nicht, dass sie meine Ideen stehlen. Mich beunruhigt, dass sie keine eigenen haben.

NIKOLA TESLA

Wardenclyffe Tower

Teslas Arbeit an diesem Projekt führte zur Entwicklung der Wardenclyffe Tower, einer gigantischen Sendeanlage auf Long Island. Der Turm war als Herzstück eines globalen Kommunikationsnetzwerks gedacht, das Radio- und Telefonverbindungen über den Atlantik ermöglichen sollte. Trotz der anfänglichen Unterstützung durch Morgan stießen Teslas ambitionierte Pläne jedoch bald auf finanzielle Schwierigkeiten. Die Kosten für den Bau und die Inbetriebnahme des Turms überstiegen die ursprünglichen Schätzungen erheblich, und die zunehmende Skepsis von Investoren sowie technische Herausforderungen führten letztlich dazu, dass das Projekt eingestellt wurde.

Obwohl der Wardenclyffe Tower und das damit verbundene transatlantische Kommunikationsprojekt letztendlich scheiterten, bleibt Teslas Beitrag zur Entwicklung der drahtlosen Kommunikation unbestritten. Seine Arbeiten legten den Grundstein für spätere Entwicklungen in der Radiotechnik und hatten einen tiefgreifenden Einfluss auf die moderne Kommunikationstechnologie. Nikola Teslas Visionen und sein unermüdlicher Innovationsgeist leben in den technologischen Fortschritten weiter, die heute als selbstverständlich gelten.

Der Mensch Nikola Tesla

Nikola Tesla verstarb am 7. Januar 1943 in New York City, allein, was die Art und Weise widerspiegelt, wie er den Großteil seines Lebens geführt hatte. Trotz seines enormen Einflusses auf die Wissenschaft und seine zahlreichen bahnbrechenden Erfindungen ist über sein persönliches Leben verhältnismäßig wenig bekannt, insbesondere in Bezug auf zwischenmenschliche Beziehungen. Tesla hatte sein Leben der Forschung und Entwicklung neuer Technologien gewidmet und dabei persönliche Beziehungen oft in den Hintergrund gestellt.

Es gibt keine Aufzeichnungen über romantische Beziehungen oder dauerhafte Bindungen zu Frauen, was darauf hindeutet, dass er ein sehr privater Mensch war, dessen Hauptleidenschaft seine Arbeit war. Diese Zurückgezogenheit hat sicherlich dazu beigetragen, dass er sich so intensiv seinen Forschungen widmen konnte, jedoch auch dazu, dass er seine letzten Jahre in Einsamkeit verbrachte.

Sei allein, dies ist das Geheimnis von Erfindungen. In der Einsamkeit werden Ideen geboren.

NIKOLA TESLA

Vermächtnis und Würdigung

Nikola Tesla, geboren am 10. Juli 1856 im heutigen Kroatien, war ein visionärer Erfinder, dessen Genie und Innovationen die Grundlagen für viele moderne Technologien geschaffen haben. Bekannt für seine Pionierarbeit im Bereich der Elektrizität und Magnetismus, hat Tesla mit seinen Entwicklungen in der Wechselstromtechnik, drahtloser Kommunikation und Energieübertragung die Welt nachhaltig verändert. Seine Beiträge umfassen die Erfindung des Wechselstrommotors, die Entwicklung der Radio- und Transformatortechnik sowie die Vorstellung revolutionärer Konzepte für die drahtlose Energieübertragung, die seiner Zeit weit voraus waren.

Tesla war ein Meister der elektrischen Innovation, dessen Arbeiten die elektrische Revolution des 20. Jahrhunderts entscheidend prägten. Durch die Einführung des Wechselstromsystems hat Tesla ermöglicht, dass elektrische Energie effizient über lange Distanzen transportiert werden kann, was die Massenelektrifizierung von Städten und Industrien weltweit vorantrieb. Seine Erfindungen und theoretischen Arbeiten haben fundamentale Beiträge zur Entwicklung der modernen Elektrizitätsversorgung, der elektromechanischen Industrie und sogar der Radio- und Fernsehtechnik geleistet.

Trotz der enormen Tragweite seiner Erfindungen und seines technischen Scharfsinns erkannte Tesla die Bedeutung seiner Arbeit für die Gesellschaft und strebte danach, die Welt zu einem besseren Ort zu machen. Er träumte von einer Welt, in der Energie frei und zugänglich für alle wäre, ein Ziel, das seine Forschungen bis zu seinem Lebensende antrieb.

Obwohl Nikola Tesla in seinen letzten Lebensjahren von finanziellen Schwierigkeiten und Vergessenheit geplagt war, erlebt sein Erbe heute eine Renaissance, da seine Visionen und Konzepte weiterhin Ingenieure, Wissenschaftler und Erfinder inspirieren. Tesla starb am 7. Januar 1943 in New York City, doch sein Vermächtnis überlebt in den zahlreichen Technologien, die das Fundament unserer modernen Gesellschaft bilden.

Seine Leistungen wurden posthum anerkannt und gewürdigt, und er wird heute als einer der größten Erfinder und Denker der Geschichte betrachtet. In Anerkennung seiner Beiträge zur Wissenschaft und Technik wurde die Einheit der magnetischen Flussdichte, das Tesla, nach ihm benannt, was seine bleibende Präsenz in der wissenschaftlichen Gemeinschaft sichert. Nikola Tesla bleibt eine faszinierende und inspirierende Figur, deren Leben und Werk weiterhin faszinieren und motivieren. Tesla ist nicht nur ein Symbol für Innovation, sondern auch ein Beispiel dafür, wie weit Vorstellungskraft und technischer Weitblick einen einzelnen Menschen tragen können.

NUTZUNG | HAFTUNG

Trotz sorgfältiger Kontrolle übernehmen wir keine Gewähr für die Richtigkeit und Vollständigkeit der Inhalte.

Netzwerk-Video Helligkeit und Blendung

In der Netzwerk-Videoüberwachungstechnik spielen Helligkeit und Blendung eine zentrale Rolle bei der Qualität und Effektivität der Videoaufnahmen. Für Überwachungssysteme sind diese Faktoren entscheidend, um klare und verwertbare Aufnahmen zu gewährleisten. Zu den Herausforderungen welche mit Helligkeit und Blendung einhergehen, gibt es praxiserprobte Lösungen.

Inhaltsverzeichnis

Helligkeit und Blendung: Einblicke in visuelle Wahrnehmung

In der Welt der visuellen Wahrnehmung sind Helligkeit und Blendung zwei zentrale Aspekte, die sowohl den Komfort als auch die Effizienz unserer Sehfähigkeiten beeinflussen. Helligkeit wird als die subjektiv wahrgenommene Lichtintensität (Lichtstärke) eines bestimmten Bereichs verstanden, wohingegen Blendung durch einen zu starken Kontrast zwischen hellen und dunklen Zonen im Sichtfeld entsteht. Diese beiden Phänomene haben bedeutende Auswirkungen auf unsere alltägliche Erfahrung.

Netzwerk-Video Helligkeit: Subjektive Wahrnehmung von Licht

Helligkeit ist eine subjektive Größe, die beschreibt, wie hell ein Licht oder ein beleuchteter Bereich einem Betrachter erscheint. Diese Wahrnehmung kann stark variieren, abhängig von der Umgebungshelligkeit und der individuellen Sensibilität des Betrachters. Zum Beispiel wird dieselbe Lichtquelle in einem dunklen Raum als viel heller wahrgenommen als in einem bereits gut beleuchteten Raum. Diese subjektive Natur der Helligkeit macht sie zu einem wichtigen Faktor.

Netzwerk-Video Blendung: Kontrast und Unbehagen

Blendung tritt auf, wenn es in unserem Sichtfeld einen signifikanten Unterschied zwischen sehr hellen und sehr dunklen Bereichen gibt. Dies kann unangenehm sein und die Fähigkeit, feine Details zu sehen, erheblich beeinträchtigen.

Absorption, Streuung und Reflexion

Entscheidend für Helligkeit und Blendung ist die Oberfläche wie das Material der Objekte, diese sind maßgeblich dafür verantwortlich wie wir Dinge sehen und wahrnehmen. In diesem Zusammenhang sind bei der Auslegung von Netzwerk-Video physikalische Eigenschaften von Oberflächen und Materialstrukturen zu berücksichtigen.

Absorption

Manche Materialoberflächen haben die Fähigkeit, Licht zu absorbieren, was ihre Farb- und Wärmeeigenschaften wesentlich beeinflusst. Farbige Oberflächen absorbieren bestimmte Wellenlängen des Lichts, während sie andere reflektieren, was zur Folge hat, dass sie in einer spezifischen Farbe wahrgenommen werden. Eine schwarze Oberfläche hingegen absorbiert fast das gesamte auf sie einfallende Lichtspektrum und reflektiert kaum Licht zurück, wodurch sie schwarz erscheint. Die absorbierte Lichtenergie wird in der Regel in Wärme umgewandelt, was dazu führt, dass dunkle Materialien sich unter Lichteinwirkung schnell erwärmen können. Dieser Umwandlungsprozess von Lichtenergie in Wärme ist ein zentraler Aspekt bei der Gestaltung von Materialien und Oberflächen. Materialien und Objekte die Licht komplett absorbieren sind für Netzwerk-Videokameras nicht sichtbar.

Streuung

Streuende Materialien spielen eine wichtige Rolle in der Manipulation von Licht, indem sie dessen Richtung und Charakteristika verändern, sobald es durch sie hindurchgeht. Wenn Licht auf solche Materialien trifft, wird es in verschiedene Richtungen gestreut statt geradlinig hindurchzutreten oder reflektiert zu werden. Diese Streuung entsteht durch die Interaktion des Lichts mit den Mikrostrukturen oder Unregelmäßigkeiten innerhalb des Materials. Das Resultat ist eine diffuse Ausbreitung des Lichts, die oft dazu genutzt wird, Blendung zu reduzieren oder ein weicheres, gleichmäßigeres Licht zu erzeugen. Diese Eigenschaften machen streuende Materialien besonders wertvoll in Anwendungen wie der Beleuchtungstechnik.

Reflexion und Reflexionsgrad

Wenn Licht auf eine Oberfläche auftrifft, kann es reflektiert werden, wobei die Art der Oberfläche maßgeblich bestimmt, wie diese Reflexion stattfindet. Glatte Oberflächen wie Spiegel oder poliertes Metall erzeugen eine spiegelnde Reflexion, bei der Lichtstrahlen in einem definierten Winkel zurückgeworfen werden, der dem Einfallswinkel entspricht. Dies ermöglicht klare und unverzerrte Bilder. Rauere Oberflächen hingegen, wie Beton oder unpoliertes Holz, führen zu einer diffusen Reflexion, bei der das Licht in viele Richtungen gestreut wird. Diese Art der Reflexion verhindert die Bildung klarer Bilder und gibt der Oberfläche ein mattes Aussehen. Die Reflexionseigenschaften einer Oberfläche spielen eine entscheidende Rolle in der optischen Wahrnehmung und sind von großer Bedeutung für Anwendungen in der Beleuchtung.

Der Reflexionsgrad ist eine wichtige physikalische Größe, die das Verhältnis zwischen der von einem Objekt reflektierten und der auf dieses Objekt einfallenden Lichtleistung beschreibt. Er wird typischerweise in Prozent angegeben und zeigt auf, wie viel Licht von der Oberfläche eines Materials zurückgeworfen wird. Verschiedene Materialien und Oberflächen weisen unterschiedliche Reflexionsgrade auf, was direkte Auswirkungen auf ihr Erscheinungsbild und ihre thermischen Eigenschaften hat. Die Energie, die nicht reflektiert wird, wird vom Material absorbiert. Diese absorbierte Energie wird meist in Wärme umgewandelt, was bei der Gestaltung von Beleuchtungskonzepten, in der Architektur und bei Materialwissenschaften berücksichtigt werden muss, um Überhitzung und Energieeffizienz zu optimieren.

Der Reflexionsgrad von Oberflächen spielt eine entscheidende Rolle in der Effizienz und Effektivität von Netzwerk-Videosystemen. Ein hoher Reflexionsgrad kann zu Blendeffekten führen, die die Bildqualität von Überwachungskameras beeinträchtigen, während ein niedriger Reflexionsgrad dazu beiträgt, dass mehr Licht absorbiert wird, was die Sichtbarkeit in schlecht beleuchteten Bereichen beeinträchtigt. Für die Optimierung von Netzwerk-Videosystemen ist es daher essentiell, das Verhalten von reflektiertem Licht zu verstehen und gegebenenfalls durch den Einsatz geeigneter Materialien und Oberflächen oder durch Anpassung der Kameraeinstellungen zu kontrollieren. So kann die Reflexion minimiert und eine gleichmäßige Bildausleuchtung gewährleistet werden, was letztlich die Zuverlässigkeit und Genauigkeit der aufgenommenen Videodaten verbessert. Dies ist insbesondere wichtig in Umgebungen, wo präzise Bildinformationen für Sicherheits- oder Überwachungszwecke erforderlich sind.

Spiegelreflexion

Wenn eine Oberfläche Licht auf eine Weise reflektiert, die dem Verhalten eines Spiegels entspricht, spricht man von Spiegelreflexion. Diese Art der Reflexion tritt bei glatten und hochglänzenden Oberflächen auf, wie bei einem herkömmlichen Spiegel oder poliertem Metall. Bei der Spiegelreflexion ist der Einfallswinkel des Lichts immer gleich dem Ausfallswinkel. Dies bedeutet, dass das Licht in einem sehr spezifischen und berechenbaren Muster reflektiert wird, wodurch klare und präzise Bilder oder Lichteffekte entstehen können.

Diffuse Reflexion

Bei diffuser Reflexion streut eine Oberfläche das Licht in alle Richtungen zurück, was auf winzige Unregelmäßigkeiten auf der reflektierenden Oberfläche zurückzuführen ist. Diese Unregelmäßigkeiten können mikroskopisch kleine Vertiefungen oder Erhebungen sein, die dazu führen, dass einfallende Lichtstrahlen in unterschiedliche Richtungen reflektiert werden, anstatt einen geordneten Reflexionswinkel wie bei spiegelnder Reflexion zu folgen. Dieses Phänomen ermöglicht eine gleichmäßige Lichtverteilung, wodurch Objekte aus verschiedenen Blickwinkeln sichtbar sind, ohne dass Blendeffekte oder helle Reflexe auftreten. Diffuse Reflexion ist ein Schlüsselfaktor für die visuelle Wahrnehmung in unserem Alltag, da sie die Art und Weise beeinflusst, wie Farben und Texturen unter verschiedenen Beleuchtungsbedingungen erscheinen.

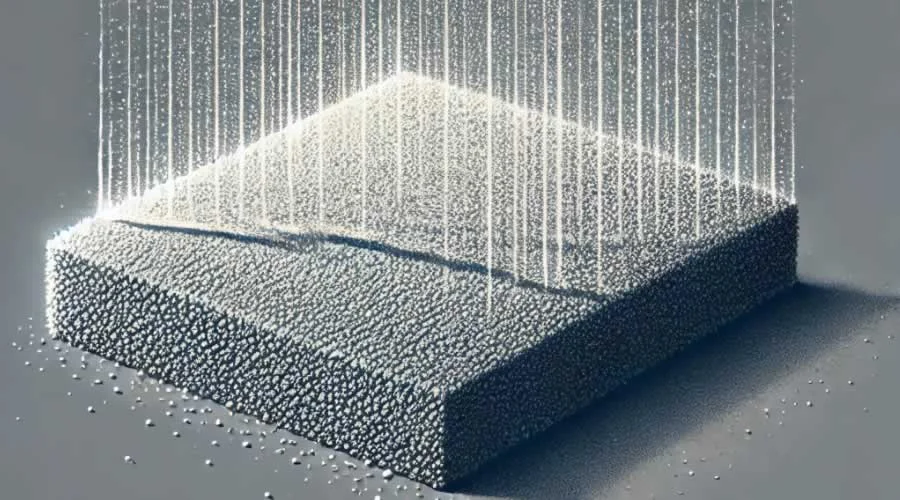

Retroreflexion

Retroreflexion ist ein spezieller Typ der Lichtreflexion, bei dem eine Oberfläche das Licht direkt in die Richtung zurückwirft, aus der es gekommen ist. Diese besondere Eigenschaft macht retroreflektierende Materialien ideal für Anwendungen, bei denen hohe Sichtbarkeit gefordert ist, besonders unter schlechten Lichtverhältnissen. Verkehrsschilder, Fahrzeugkennzeichen und auch Kleidung für Fußgänger oder Radfahrer bei Nacht sind häufig mit retroreflektierenden Oberflächen ausgestattet. Diese Materialien enthalten winzige Glasperlen oder komplexe prismatische Strukturen, die eingehendes Licht in seiner Einfallsrichtung zurückwerfen.

Fazit

Das Management von Helligkeit und Blendung ist ein zentraler Aspekt bei der Optimierung von Netzwerk-Videosystemen. Die richtige Balance zu finden, ist entscheidend für die Erzielung einer hohen Bildqualität und die Effektivität der Videoüberwachung. Zu helle oder zu dunkle Szenen können wichtige Details verbergen, während Blendung die Klarheit und Erkennbarkeit von Objekten und Personen beeinträchtigen kann. Technologien wie Wide Dynamic Range (WDR) sind dabei hilfreich, da sie es ermöglichen, Bilder aus extrem hellen und dunklen Bereichen zu normalisieren und so ein ausgewogeneres und detailreicheres Bild zu liefern.

NUTZUNG | HAFTUNG

Trotz sorgfältiger Kontrolle übernehmen wir keine Gewähr für die Richtigkeit und Vollständigkeit der Inhalte.

Potentialsteuerung bei Elektroinstallationen

Im Bereich der Elektroinstallationen ist die Potentialsteuerung eine essenzielle bauliche Maßnahme, die zum Schutz vor elektrischen Gefahren beiträgt. Insbesondere in Umgebungen, in denen hohe Ströme durch den Erder fließen, spielt sie eine entscheidende Rolle, um die Sicherheit zu gewährleisten.

Inhaltsverzeichnis

Was ist Potentialsteuerung?

Potentialsteuerung bezeichnet Techniken und Maßnahmen, die darauf abzielen, elektrische Spannungen im Bereich elektrisch leitfähiger Baumaterialien zu minimieren. Diese Spannungen können durch verschiedene Quellen entstehen, darunter Fehlerströme, Blitzeinschläge oder andere elektrische Störungen. Im Kontext von Elektroinstallationen bedeutet dies, dass die Potentialsteuerung dazu beiträgt, Unterschiede im elektrischen Potenzial zwischen verschiedenen Punkten zu verringern.

Warum ist Potentialsteuerung wichtig?

In Umgebungen, in denen hohe Ströme durch den Erder fließen, können sogenannte Schrittspannungen auftreten. Schrittspannungen entstehen, wenn eine Person mit ihren Füßen zwei Punkte am Boden berührt, die unterschiedliche elektrische Potenziale haben. Dies kann zu gefährlichen Stromschlägen führen, die schwerwiegende Verletzungen oder sogar den Tod zur Folge haben können. Die Potentialsteuerung wirkt dem entgegen, indem sie die elektrischen Potenzialdifferenzen verringert und somit das Risiko von Schrittspannungen minimiert oder ganz eliminiert.

Technische Umsetzung der Potentialsteuerung

Die praktische Umsetzung der Potentialsteuerung erfolgt durch verschiedene bauliche Maßnahmen:

Erdungsanlagen

Eine der grundlegendsten Maßnahmen ist die Installation von Erdungsanlagen, die elektrische Ströme sicher in die Erde ableiten. Dies reduziert die Potenzialdifferenzen im Bodenbereich effektiv. Klassisch für Erdungsanlagen sind Fundamenterder, Tiefenerder sowie Ringerder.

Fundamenterder sind integrale Bestandteile moderner Bauwerke und dienen der sicheren Ableitung elektrischer Ströme in das Erdreich. Sie werden in das Betonfundament eines Gebäudes eingebettet, meist als Rundleiter aus nicht korrosionsanfälligem Material wie Edelstahl oder verzinktem Stahl. Der Fundamenterder nutzt die großflächige Kontaktfläche des Fundaments zur Erde, was eine sehr geringe Erdungsimpedanz gewährleistet. Diese Methode bietet eine besonders langlebige und zuverlässige Erdungslösung, da der Erder durch den Beton vor mechanischen und korrosiven Einflüssen geschützt ist.

Der Fundamenterder spielt eine zentrale Rolle im Schutz vor elektrischen Schlägen und Blitzeinschlägen und trägt zur Einhaltung der elektrotechnischen Sicherheitsnormen bei. Zudem ermöglicht er einen effektiven Potentialausgleich innerhalb des Gebäudes, was zur Vermeidung von Spannungsschwankungen und elektrischen Störungen beiträgt. Die Installation muss sorgfältig geplant und ausgeführt werden, um eine durchgehende elektrische Verbindung im gesamten Fundament zu gewährleisten.

Tiefenerder sind spezielle Erdungselektroden, die tief in den Boden eingebracht werden, um eine zuverlässige elektrische Verbindung zur Erde herzustellen. Sie bestehen in der Regel aus korrosionsbeständigem Material wie verzinktem Stahl, Edelstahl oder Kupfer und werden vertikal in den Boden getrieben oder gebohrt. Die Tiefe, in der Tiefenerder installiert werden, kann mehrere Meter betragen, was besonders in Regionen mit hoher Bodenwiderstandsfähigkeit oder schlechter Leitfähigkeit des Oberbodens notwendig ist.

Tiefenerder bieten den Vorteil, dass sie unabhängig von den Bodenbedingungen an der Oberfläche stets eine stabile und niedrige Erdungsimpedanz gewährleisten. Dies ist besonders wichtig in Bereichen mit stark schwankenden Witterungsbedingungen oder in industriellen Anlagen, wo eine zuverlässige Erdung für den Schutz von Mensch und Technik unverzichtbar ist. Die Installation von Tiefenerdern erfordert spezielle Ausrüstung und Fachkenntnisse, um eine optimale Funktion und Langlebigkeit der Erdungsanlage sicherzustellen.

Ringerder sind eine spezielle Form von Erdungselektroden, die zur sicheren Ableitung von elektrischen Strömen in das Erdreich eingesetzt werden. Sie bestehen aus leitfähigem Material wie verzinktem Stahl oder Kupfer und werden ringförmig um ein Gebäude oder eine Anlage verlegt. Der Ringerder wird in der Regel in einem Graben um das Fundament in einer Tiefe von etwa 0,5 bis 1 Meter eingebettet.

Diese Anordnung sorgt für eine gleichmäßige Verteilung des Erdungswiderstands und bietet eine zuverlässige Erdungsverbindung, die besonders in Gebieten mit unterschiedlicher Bodenleitfähigkeit vorteilhaft ist. Ringerder sind effektiv im Schutz gegen Blitzeinschläge und elektrischen Fehlströme, da sie eine große Kontaktfläche mit dem Erdreich haben und somit eine stabile und geringe Erdungsimpedanz gewährleisten. Sie tragen wesentlich zur Sicherheit von elektrischen Installationen und zur Einhaltung der entsprechenden Normen und Vorschriften bei. Die Installation von Ringerdersystemen erfordert eine präzise Planung und fachgerechte Ausführung.

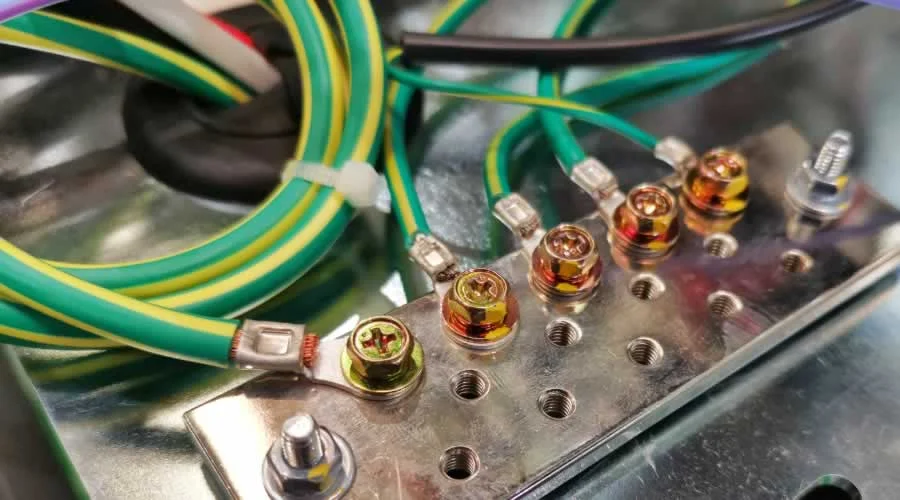

Potentialausgleich

Der Potentialausgleich verbindet alle leitfähigen Teile einer Anlage miteinander und mit der Erdungsanlage. Dies stellt sicher, dass keine gefährlichen Spannungsunterschiede zwischen verschiedenen Bauteilen entstehen.

Eine Potentialausgleichsschiene, auch Hauptpotentialausgleichsschiene genannt, ist ein zentrales Element in der elektrotechnischen Installation eines Gebäudes, das zur Sicherstellung eines einheitlichen elektrischen Potentials aller leitfähigen Teile beiträgt. Sie wird in der Regel im Keller oder im Technikraum eines Gebäudes installiert und dient als Sammelpunkt, an den alle Erdungsleiter, Schutzleiter, metallenen Rohrleitungen und andere leitfähige Teile angeschlossen werden.

Die Potentialausgleichsschiene reduziert die Gefahr von Spannungsunterschieden zwischen verschiedenen Teilen der elektrischen Anlage und erhöht somit die Sicherheit, indem sie das Risiko von elektrischen Schlägen und Störungen minimiert. Sie besteht meist aus einem robusten, korrosionsbeständigen Material wie Kupfer oder Edelstahl und ist so konstruiert, dass sie eine dauerhafte, niederohmige Verbindung gewährleistet.

Verwendung leitfähiger Materialien

Der Einsatz leitfähiger Baumaterialien, die gut mit der Erdungsanlage verbunden sind, kann ebenfalls dazu beitragen, elektrische Spannungen zu minimieren.

Leitfähige Materialien spielen eine entscheidende Rolle in der Potentialsteuerung, um sichere und effiziente elektrische Systeme zu gewährleisten. In der Potentialsteuerung, die darauf abzielt, alle leitfähigen Teile eines elektrischen Systems auf ein gemeinsames Potential zu bringen und Spannungsdifferenzen zu minimieren, sind Materialien wie Kupfer und Aluminium von besonderer Bedeutung. Diese Materialien werden in Potentialausgleichsschienen, Erdungsleitungen und Verbindungsbrücken verwendet, um eine niederohmige und stabile elektrische Verbindung sicherzustellen. Durch den Einsatz von hochwertigen leitfähigen Materialien wird gewährleistet, dass unerwünschte Spannungen und elektrische Störungen vermieden werden, was die Sicherheit und Zuverlässigkeit des gesamten Systems erhöht.

Isolierung und Abschirmung

In bestimmten Fällen kann auch die Isolierung oder Abschirmung von Leitungen und Bauteilen eine effektive Maßnahme zur Reduzierung von Spannungsdifferenzen sein. Isolierung verhindert unerwünschte elektrische Kontakte und schützt vor Kurzschlüssen, indem sie eine nichtleitende Barriere um elektrische Leiter bildet. Abschirmung hingegen verwendet leitfähige Materialien, um elektromagnetische Interferenzen (EMI) zu blockieren und elektromagnetische Felder zu kontrollieren. Dies ist besonders wichtig in sensiblen elektronischen Anwendungen, wo elektromagnetische Störungen die Funktion und Zuverlässigkeit von Geräten beeinträchtigen können.

Durch die Kombination von Isolierung und Abschirmung wird nicht nur die elektrische Sicherheit erhöht, sondern auch die Signalqualität und Systemleistung verbessert. Diese Techniken sind essenziell in der Hochfrequenztechnik, Telekommunikation und Medizintechnik, wo präzise und störungsfreie Signalübertragung erforderlich ist. Die richtige Auswahl und Anwendung von Isolier- und Abschirmmaterialien tragen somit maßgeblich zur Reduzierung von Spannungsdifferenzen und zur Sicherstellung eines stabilen und sicheren Betriebs von elektrischen und elektronischen Systemen bei.

Vorteile der Potentialsteuerung

Die Implementierung einer effektiven Potentialsteuerung bietet mehrere Vorteile. So wird durch die Reduzierung von Schrittspannungen wird das Risiko von Stromschlägen deutlich verringert. Schrittspannungen entstehen, wenn eine Person innerhalb eines elektrischen Spannungsfeldes, wie es beispielsweise bei einem Blitzeinschlag in den Boden auftritt, einen Schritt macht und dabei unterschiedliche Potenziale berührt. Solche Spannungsdifferenzen können gefährliche Stromflüsse durch den Körper verursachen. Maßnahmen zur Reduzierung von Schrittspannungen umfassen die Installation von Erdungsanlagen, wie Ringerdern oder Tiefenerdern, die das Spannungsgefälle im Erdreich verringern.

Auch der Einsatz von isolierenden Matten oder speziellen Bodenbelägen in gefährdeten Bereichen kann das Risiko mindern. Durch diese Vorkehrungen wird die Spannung, die zwischen den Füßen einer Person auftreten kann, auf ein ungefährliches Niveau reduziert, was die Wahrscheinlichkeit eines Stromschlags erheblich senkt. Insbesondere in Bereichen mit hoher Blitzschlaggefahr oder in elektrischen Anlagen ist die Reduzierung von Schrittspannungen ein wichtiger Aspekt des Sicherheitsmanagements, um den Schutz von Menschen und Tieren zu gewährleisten.

Eine gut durchdachte Potentialsteuerung kann die Lebensdauer von Elektroinstallationen erheblich erhöhen, indem sie schädliche Spannungen und daraus resultierende Schäden minimiert. Durch die gezielte Verbindung aller leitfähigen Teile auf ein einheitliches elektrisches Potential werden Spannungsunterschiede ausgeglichen, die ansonsten zu unerwünschten Stromflüssen und elektromagnetischen Störungen führen könnten. Solche Störungen können die Integrität von Kabeln, Geräten und elektrischen Komponenten beeinträchtigen, was zu vorzeitigem Verschleiß und Funktionsausfällen führen kann.

Zudem schützt eine effektive Potentialsteuerung vor Überspannungen, die durch äußere Einflüsse wie Blitzeinschläge oder Schaltvorgänge verursacht werden. Durch den Einsatz von Potentialausgleichsschienen, hochwertigen Erdungssystemen und geeigneten leitfähigen Materialien wird nicht nur die Sicherheit erhöht, sondern auch die Stabilität und Zuverlässigkeit der gesamten elektrischen Anlage verbessert. Dies trägt dazu bei, Wartungskosten zu senken und die Lebensdauer der Installationen zu verlängern, indem potenzielle Schäden frühzeitig verhindert werden.

Fazit

Die Potentialsteuerung ist eine unverzichtbare Maßnahme im Bereich der Elektroinstallationen, um die Sicherheit von Menschen und Tieren zu gewährleisten. Durch die Minimierung von elektrischen Spannungen in leitfähigen Baumaterialien und die Reduzierung gefährlicher Schrittspannungen trägt sie maßgeblich zur Vermeidung von Unfällen und zur Erhöhung der Zuverlässigkeit und Langlebigkeit elektrischer Anlagen bei. Die sorgfältige Planung und Umsetzung dieser Maßnahmen sollte daher ein integraler Bestandteil jeder Elektroinstallation sein.

NUTZUNG | HAFTUNG

Trotz sorgfältiger Kontrolle übernehmen wir keine Gewähr für die Richtigkeit und Vollständigkeit der Inhalte.

CCTV-Gutachten

CCTV-Gutachten für Überwachungssysteme sind essenziell, um die Leistungsfähigkeit, Normenkonformität und Sicherheit von Videoüberwachungssystemen zu bewerten. Sie helfen Unternehmen, Institutionen und Privatpersonen, die Effizienz ihrer Überwachungslösungen zu optimieren und sicherzustellen, dass diese den aktuellen technischen und rechtlichen Anforderungen entsprechen.

Inhaltsverzeichnis

Inhalt und Durchführung eines CCTV-Gutachtens

Ein umfassendes CCTV-Gutachten beinhaltet mehrere zentrale Aspekte. Zu diesen zählen:

Bestandsaufnahme und Analyse: Zunächst erfolgt eine detaillierte Bestandsaufnahme des bestehenden Überwachungssystems. Dies beinhaltet u. a. die Überprüfung der installierten CCTV-Technik, der Netzwerkarchitektur sowie der eingesetzten Software.

Normenkonformität: Ein wichtiger Bestandteil des Gutachtens ist die Überprüfung der Systeme auf Konformität mit geltenden Normen und Standards, wie der DIN EN 62676, Videoüberwachungsanlagen für Sicherheitsanwendungen. Diese letztgenannte Norm definiert unter anderem die Systemanforderungen wie die Bildqualität von Kameras. Diese für CCTV-Gutachten wichtigste Norm besteht aus mehreren Teilen.

- DIN EN 62676 Teil 1-1: Systemanforderungen – Allgemeines

- DIN EN 62676 Teil 1-2: Systemanforderungen – Allgemeine Anforderungen an die Videoübertragung

- DIN EN 62676 Teil 2-1: Videoübertragungsprotokolle – Allgemeine Anforderungen

- DIN EN 62676 Teil 2-2: Videoübertragungsprotokolle – IP-Interoperabilität auf Basis von HTTP- und REST-Diensten

- DIN EN 62676 Teil 3: Analoge und digitale Videoschnittstellen

- DIN EN 62676 Teil 4: Anwendungsregeln

- DIN EN 62676 Teil 5: Leistungsbeschreibung und Bildqualitätseigenschaften für Kameras

Leistungsbewertung: Die Leistungsfähigkeit der Videoüberwachung wird anhand verschiedener Kriterien bewertet. Dazu gehören die Bildauflösung, die Überwachungskegel der Kameras, die Qualität der Aufnahmen bei unterschiedlichen Lichtverhältnissen sowie die Zuverlässigkeit der Übertragung und Speicherung der Daten.

Sicherheitsprüfung: Ein weiterer Schwerpunkt liegt auf der Sicherheitsprüfung der Systeme. Hierbei wird geprüft, ob die Überwachungsanlagen ausreichend vor Manipulationen und unbefugtem Zugriff geschützt sind. Dies Überprüfung umfasst auch die Evaluierung der Zugriffsrechte und der Datenschutzmaßnahmen.

Empfehlungen und Optimierungsvorschläge: Basierend auf den Ergebnissen der Analyse und Bewertung werden Empfehlungen zur Verbesserung des Videoüberwachungssystems ausgesprochen. Dies kann die Anpassung oder Erweiterung der CCTV-Hardware, die Optimierung der Netzwerkstruktur oder die Implementierung zusätzlicher Sicherheitsmaßnahmen umfassen.

CCTV-Gutachten Vorteile

Die Erstellung eines CCTV-Gutachtens ist je nach Anlagengröße kein, in Bezug auf die Kosten, günstiger Prozess. Je nach Situation bietet ein Gutachten jedoch mehrere Vorteile:

Sicherheit: Durch die Identifikation und Behebung von Schwachstellen wird die Sicherheit der überwachten Bereiche erhöht.

Rechtssicherheit: Durch die Einhaltung gesetzlicher und normativer Anforderungen wird sichergestellt, dass rechtliche Risiken minimiert werden.

Effizienzsteigerung: Optimierungspotenziale werden erkannt und können umgesetzt werden, was die Effektivität der Überwachungssysteme erhöht. In diesem Zusammenhang wird häufig eine Wirksamkeitsanalyse bei CCTV-Installationen durchgeführt. Die Wirksamkeitsanalyse von Videokameraüberwachung befasst sich mit der Bewertung, inwieweit Überwachungssysteme ihre beabsichtigten Sicherheitsziele erreichen. Dabei werden verschiedene Faktoren berücksichtigt, wie die Abschreckung von kriminellem Verhalten durch Positionierung der Überwachungskameras, die Identifizierung von Straftätern durch Auswertung der Überwachungsqualität und die Sammlung von Beweismaterial nach Art und Qualität.

Diese Analyse kann quantitative und qualitative Methoden umfassen, einschließlich statistischer Auswertungen von Kriminalitätsraten vor und nach der Installation von Kameras, sowie Umfragen zur Wahrnehmung der Sicherheit bei Anwohnern und Passanten. Wichtig ist auch die Betrachtung von Datenschutzaspekten und der Akzeptanz der Bevölkerung. Die Ergebnisse solcher Gutachten sind entscheidend für politische Entscheidungsträger und Sicherheitsdienste, um die Effektivität der Überwachungstechnologien zu optimieren und deren Einsatz im Einklang mit rechtlichen sowie ethischen Standards zu gewährleisten.

Transparenz: Eine unabhängige Bewertung schafft Transparenz über den Zustand und die Leistungsfähigkeit des Überwachungssystems.

CCTV-Gutachten Kosten

Gutachten für Videoüberwachungssysteme sind entscheidend, um Aspekte wie Funktionalität, Sicherheit und rechtliche Konformität zu evaluieren. Diese Gutachten können in ihren Kosten stark variieren, wobei die Preise von mehreren Faktoren abhängen. Typischerweise liegen die Stundensätze für die Erstellung von CCTV-Gutachten zwischen 100 € und 160 €, können aber je nach Spezifikation der Aufgabe und Art des Gutachtens, ob privat oder gerichtlich, auch darüber oder darunter liegen. Die genaue Preisgestaltung wird durch den Umfang und die Komplexität der zu überprüfenden Systeme sowie die erforderliche Expertise des Gutachters beeinflusst.

Fazit

Ein professionelles CCTV-Gutachten ist ein unverzichtbares Instrument für Institutionen, Unternehmen und Privatpersonen, die ihre Videoüberwachungssysteme optimieren und sicherstellen möchten, dass diese den höchsten Standards entsprechen. Durch die fundierte Analyse und die gezielten Verbesserungsvorschläge können sowohl die Sicherheit als auch die Effizienz der Überwachungsmaßnahmen signifikant gesteigert werden.

NUTZUNG | HAFTUNG

Trotz sorgfältiger Kontrolle übernehmen wir keine Gewähr für die Richtigkeit und Vollständigkeit der Inhalte.

WiFi 6E: Die Revolution der drahtlosen Vernetzung

In der sich stetig weiterentwickelnden Welt der drahtlosen Kommunikation markiert WiFi 6E einen bedeutenden Fortschritt gegenüber seinem Vorgänger WiFi 6 (802.11ax). Mit der Nutzung des zusätzlichen 6-GHz-Bandes bietet WiFi 6E eine deutlich höhere Bandbreite, die zuverlässige Verbindungen für eine Vielzahl von Geräten gleichzeitig ermöglicht und reibungslose Echtzeit-Anwendungen unterstützt. Diese neue Technologie bringt erhebliche Vorteile in Bereichen wie Smart-Home-Steuerung, Energieeffizienz und Sicherheitsapplikationen.

Inhaltsverzeichnis

WiFi 6E und die Zukunft der Hausautomation

WiFi 6E soll die Hausautomation revolutionieren, indem es die Vorteile der Smart-Home-Technologie voll ausschöpft. Mit der Einführung des 6-GHz-Bandes bietet WiFi 6E eine höhere Bandbreite und geringere Latenzzeiten, die für die nahtlose Integration und den effizienten Betrieb vernetzter Geräte unerlässlich sind.

Einer der größten Vorteile von WiFi 6E in der Hausautomation ist die Fähigkeit, eine größere Anzahl von Geräten gleichzeitig und ohne Leistungseinbußen zu verbinden. In modernen Haushalten, die oft mit einer Vielzahl von Smart-Home-Geräten ausgestattet sind – von intelligenten Thermostaten und Sicherheitskameras bis hin zu vernetzten Kühlschränken und Beleuchtungssystemen – sorgt WiFi 6E für eine stabile und zuverlässige Verbindung. Dies bedeutet, dass Geräte schneller und effizienter miteinander kommunizieren können, was zu einer reibungsloseren und benutzerfreundlicheren Smart-Home-Erfahrung führt.

Optimierte Steuerung und Automatisierung

Mit der höheren Kapazität und Geschwindigkeit von WiFi 6E können Smart-Home-Systeme komplexere Automatisierungen und Echtzeit-Steuerungen unterstützen. Zum Beispiel können intelligente Beleuchtungssysteme sofort auf Sprachbefehle reagieren, und Sicherheitskameras können hochauflösende Videoübertragungen ohne Verzögerung senden. Dies verbessert nicht nur die Benutzererfahrung, sondern erhöht auch die Sicherheit und Effizienz eines Hauses.

Energieeffizienz und Nachhaltigkeit

Ein weiterer wichtiger Aspekt, den WiFi 6E in die Hausautomation einbringt, ist die verbesserte Energieeffizienz. Durch die optimierte Kommunikation zwischen den Geräten können diese ihren Energieverbrauch besser verwalten, was zu längeren Batterielaufzeiten und insgesamt geringerem Energieverbrauch führt. Dies ist besonders wichtig für batteriebetriebene Geräte wie Sensoren und Smart-Home-Controller, die dadurch von einer längeren Lebensdauer profitieren.

Zukunftssicherheit und Skalierbarkeit

WiFi 6E bietet auch eine zukunftssichere Lösung für die Hausautomation. Mit der steigenden Anzahl von vernetzten Geräten und der zunehmenden Komplexität der Smart-Home-Systeme wird der Bedarf an einer robusten und leistungsfähigen Netzwerkverbindung immer wichtiger. WiFi 6E stellt sicher, dass Smart Homes auch in den kommenden Jahren zuverlässig und effizient arbeiten können, und bietet gleichzeitig die Skalierbarkeit, um zukünftige Erweiterungen und neue Technologien zu unterstützen.

Die Nutzung des 6-GHz-Bands stellt einen bedeutenden Schritt in der Welt der Hausautomation dar. Durch die Nutzung der erweiterten Bandbreite und verbesserten Leistungsmerkmale ermöglicht die auf WiFi 6 basierende Weiterentwicklung eine nahtlose, effiziente und nachhaltige Smart-Home-Erfahrung, die den Alltag der Nutzer erleichtern und verbessern kann.

WiFi 6E Techniken

WiFi 6E erweitert die Funktionen von WiFi 6, indem es das neu freigegebene 6-GHz-Band nutzt. Bisherige WiFi-Standards operierten hauptsächlich im 2,4-GHz- und 5-GHz-Bereich, was teilweise zu Überlastungen und Interferenzen führte. Das 6-GHz-Band hingegen bietet zusätzliche 1.200 MHz Spektrum, was zu einer deutlichen Reduktion von Interferenzen und einer Verbesserung der allgemeinen Netzwerkleistung führt. Der neue Standard verwendet folgende Techniken:

OFDMA (Orthogonal Frequency Division Multiple Access)

Mit der Einführung von WiFi 6E hat sich die drahtlose Kommunikation erneut weiterentwickelt, um den steigenden Anforderungen an Geschwindigkeit, Kapazität und Zuverlässigkeit gerecht zu werden. Eine der Schlüsseltechnologien welche die neue WLAN-Technologie so leistungsfähig machen, ist Orthogonal Frequency Division Multiple Access, kurz OFDMA.

Grundlagen von OFDMA

OFDMA basiert auf der Orthogonal Frequency Division Multiplexing Technologie, die das verfügbare Frequenzband in viele kleine, orthogonale Unterträger aufteilt. Jeder dieser Unterträger kann unabhängig voneinander Daten übertragen, ohne sich gegenseitig zu stören. OFDMA erweitert dieses Konzept, indem es die Unterträger dynamisch verschiedenen Nutzern oder Datenströmen zuweist abhängig von deren Bedarf und den Netzwerkbedingungen, was eine effizientere Nutzung des Frequenzspektrums ermöglicht.

Die Orthogonal Frequency Division Multiplexing Technologie reduziert die Verzögerungen und ermöglicht dadurch eine schnellere Datenübertragung, weil die Daten in kleineren Paketen übertragen werden können. Echtzeit-Anwendungen wie Videoüberwachung und Echtzeit-Kommunikation wie Online-Konferenzen profitieren von geringeren Latenzen.

MU-MIMO (Multi-User, Multiple Input, Multiple Output)

Eine weitere Schlüsseltechnologie welche WiFi 6E so effizient und leistungsfähig macht, ist Multi-User, Multiple Input, Multiple Output (MU-MIMO). MU-MIMO ermöglicht es einem Router oder Zugangspunkt, gleichzeitig mit mehreren Geräten zu kommunizieren, wodurch die Netzwerkleistung und Effizienz erheblich verbessert werden.

MU-MIMO-fähige Router müssen mehrere technische Voraussetzungen erfüllen, um die Vorteile dieser Technologie voll ausschöpfen zu können. Dazu gehören die Unterstützung aktueller WiFi-Standards, leistungsfähige Hardware, mehrere Antennen und eine optimierte Netzwerkumgebung. Durch die Erfüllung dieser Anforderungen kann MU-MIMO die Effizienz und Leistung drahtloser Netzwerke erheblich verbessern, insbesondere in Umgebungen mit vielen gleichzeitig verbundenen Geräten.

Grundlagen von MU-MIMO

MU-MIMO ist eine Technologie, die in drahtlosen Netzwerken verwendet wird, um die Datenübertragungsrate und die Netzwerkeffizienz zu erhöhen. Sie ermöglicht es einem Zugangspunkt, gleichzeitig Daten an mehrere Geräte zu senden und von diesen zu empfangen. Dies unterscheidet sich von der traditionellen MIMO-Technologie, bei der Daten nur zwischen einem Zugangspunkt und einem einzigen Gerät gleichzeitig übertragen werden können. Anstatt Daten sequentiell an einzelne Geräte zu senden, kann der Zugangspunkt mit mehreren Geräten gleichzeitig kommunizieren. Durch die gleichzeitige Übertragung werden die verfügbaren Ressourcen des Netzwerks effizienter genutzt.

In Umgebungen mit vielen gleichzeitig verbundenen Geräten, wie Büros, Stadien oder öffentlichen Hotspots, sorgt MU-MIMO für eine gleichmäßige Verteilung der Netzwerkressourcen. Zudem kann MU-MIMO die Interferenzen zwischen den Geräten reduzieren, indem es die Signalübertragung gezielt steuert.

BSS Coloring (Basic-Service-Set Coloring)

BSS Coloring ist eine Technik, die mit der Einführung von WiFi 6 (802.11ax) und WiFi 6E eingeführt wurde, um die Effizienz und Leistung drahtloser Netzwerke zu verbessern. BSS steht für Basic Service Set, was eine grundlegende Netzwerkkonfiguration in einem WLAN bezeichnet, die aus einem Access Point (AP) und den damit verbundenen Clients besteht. "Coloring" bezieht sich auf die Zuweisung einer einzigartigen Kennzeichnung (Farbe oder ID) zu jedem BSS.

In traditionellen WLAN-Netzwerken kann es zu Interferenzen kommen, wenn mehrere Access Points (APs) auf denselben Kanälen senden. Diese Interferenzen führen zu einer verringerten Netzwerkeffizienz und höheren Latenzen. BSS Coloring zielt darauf ab, diese Interferenzen zu minimieren, indem jedem BSS eine eindeutige Kennzeichnung (Farbe) zugewiesen wird.

Grundlagen von BSS Coloring

BSS (Basic Service Set) Coloring ist eine Methode zur Kennzeichnung von BSS innerhalb eines WiFi-Netzwerks. In traditionellen WiFi-Netzwerken kann es zu Interferenzen kommen, wenn mehrere Access Points (APs) auf denselben Kanälen senden. BSS Coloring hilft, diese Interferenzen zu minimieren, indem es jedem BSS eine eindeutige Kennzeichnung (Farbe) zuweist.

Jeder BSS innerhalb eines WiFi-Netzwerks wird mit einer eindeutigen Farbe, einem Identifikator, gekennzeichnet. Geräte können die Farbe der empfangenen Signale erkennen und feststellen, ob diese von ihrem eigenen oder einem benachbarten BSS stammen. Basierend auf der Farbinformation können Geräte entscheiden, ob sie das empfangene Signal ignorieren oder darauf reagieren sollen, wodurch die Effizienz der Kanalausnutzung verbessert wird. Die verbesserte Kanalausnutzung führt zu einer höheren Gesamtkapazität des Netzwerks, da mehrere APs effektiver auf denselben Kanälen operieren können. Netzwerke können durch die verbesserte Interferenzbewältigung leichter skaliert werden, ohne dass die Leistung leidet.

TWT (Target Wake Time)

Target Wake Time, kurz TWT, ist eine Technologie die entwickelt wurde, um die Energieeffizienz zu verbessern und die Netzwerkauslastung zu optimieren. TWT ermöglicht es Geräten in einem WLAN-Netzwerk die Aktivitätszeiten zu planen und zu koordinieren. Dadurch können Geräte länger im Energiesparmodus bleiben und nur dann aufwachen, wenn sie tatsächlich Daten senden oder empfangen müssen.

Grundlagen von TWT

Der Access Point (AP) und die verbundenen Geräte handeln Zeitfenster aus, in denen die Geräte aktiv sind. Die Geräte erhalten spezifische Zeitfenster, sogenannte TWT-Perioden, in denen sie aufwachen und Daten übertragen oder empfangen können. Zwischen diesen Zeitfenstern bleiben die Geräte im Energiesparmodus, was den Energieverbrauch erheblich reduziert. Durch die Reduzierung der Aktivitätszeiten können Geräte, insbesondere batteriebetriebene IoT-Geräte, ihre Batterielaufzeit verlängern. TWT ermöglicht es Geräten, den Großteil der Zeit im Schlafmodus zu verbringen, was den Energieverbrauch insgesamt senkt. Da die Aktivitätszeiten der Geräte koordiniert werden, verringert sich die Wahrscheinlichkeit von Übertragungsinterferenzen. Durch die Planung der Datenübertragungen wird die verfügbare Bandbreite effizienter genutzt, was zu einer verbesserten Netzwerkleistung führt.

WiFi 6E Herausforderungen

Eine der größten Schwächen der WiFi 6E Technologie liegt in der begrenzten Reichweite und Durchdringungsfähigkeit bedingt durch das 6-GHz-Band im Vergleich zu den bereits etablierten 2,4 GHz- und 5 GHz-Bändern. Da das 6-GHz-Band auf höhere Frequenzen setzt, leidet es unter einer kürzeren Reichweite und einer verminderten Fähigkeit, physische Hindernisse im Allgemeinen zu durchdingen. Hierzu zählen Wände, Decken, Fenster und Bewuchs.

Diese physikalischen Eigenschaften führen dazu, dass WiFi-6E-Signale in größeren Gebäuden oder dicht bebauten Gebieten schneller an Signalstärke verlieren können. Dadurch wird die effektive WLAN-Abdeckung einschränkt. In solchen Szenarien könnten Nutzer feststellen, dass ihre Verbindung instabiler wird oder die Geschwindigkeit erheblich abnimmt, sobald sie sich weiter vom Access Point entfernen oder sich hinter mehreren Hindernissen befinden. Dies stellt eine Herausforderung für die Implementierung von WiFi 6E dar, insbesondere in Umgebungen, die eine umfassende und gleichmäßige Abdeckung erfordern. Um diesem Problem entgegenzuwirken, könnte es notwendig sein, zusätzliche Access Points strategisch zu platzieren, um eine ausreichende Signalstärke und Abdeckung zu gewährleisten.

Dies erhöht jedoch die Kosten und Komplexität der Netzwerkinstallation. Trotz dieser Einschränkungen bietet WiFi 6E signifikante Vorteile in Bezug auf Geschwindigkeit und Kapazität, insbesondere in weniger stark verbauten Umgebungen oder kleineren Räumen, wo die Reichweite und Durchdringungsfähigkeit des 6-GHz-Bandes weniger problematisch sind.

Optimale WiFi 6E Abdeckung durch Quad-Band-WLAN-Mesh-System

Um die maximale Leistung von WiFi 6E voll auszuschöpfen, erscheint ein Quad-Band-WLAN-Mesh-System die optimale Lösung zu sein. Ein Quad-Band-WLAN-Mesh-System ist eine fortschrittliche Netzwerkarchitektur, die entwickelt wurde, um eine stabile, schnelle und weitreichende drahtlose Internetverbindung zu gewährleisten. Im Gegensatz zu herkömmlichen Dual- oder Tri-Band-Systemen nutzt ein Quad-Band-System vier separate Frequenzbänder, um die Netzwerkleistung und -effizienz erheblich zu verbessern.

Grundlegende Funktionsweise des Quad-Band-WLAN-Mesh-Systems

Ein Quad-Band-WLAN-Mesh-System ist eine hochmoderne Lösung für diejenigen, die eine zuverlässige, schnelle und weitreichende WLAN-Abdeckung benötigen. Durch die Nutzung von vier separaten Frequenzbändern und der Implementierung eines dedizierten Backhaul-Bandes bietet dieses System eine optimale Leistung und Effizienz, die in modernen Gebäudeumgebungen unerlässlich ist.

Zwei 2,4-GHz-Bänder: Diese Bänder bieten eine größere Reichweite und sind ideal für ältere Geräte oder solche, die keine hohen Datenraten benötigen.

Zwei 5-GHz-Bänder: Diese Bänder bieten höhere Geschwindigkeiten und geringere Latenzen, eignen sich hervorragend für moderne Geräte, die hohe Datenraten erfordern.

Ein 6-GHz-Band: In WiFi 6E Systemen bietet das 6-GHz-Band zusätzliche Bandbreite und geringere Interferenzen. Dies führ zu einer besseren Gesamtleistung.

Ein entscheidendes Merkmal eines Quad-Band-Systems ist die Zuweisung eines Bandes ausschließlich für die Kommunikation zwischen dem Hauptrouter und den Mesh-Satelliten (Backhaul). Dies stellt sicher, dass die Datenübertragung zwischen den Knoten nicht die Bandbreite beeinträchtigt, die für die Endgeräte verfügbar ist.

Durch die Aufteilung des Netzwerks in vier Bänder können mehr Geräte gleichzeitig mit hoher Geschwindigkeit und geringeren Interferenzen verbunden werden. Mesh-Systeme bestehen aus mehreren Knotenpunkten, die strategisch platziert werden können, um eine umfassende WLAN-Abdeckung sicherzustellen. Das Quad-Band-System verbessert diese Abdeckung zusätzlich, indem es den Datenverkehr effizienter verwaltet.

Ein Mesh-System kann leicht erweitert werden, indem zusätzliche Knoten hinzugefügt werden. Dies ist besonders nützlich in großen Gebäuden wo herkömmliche Router möglicherweise nicht ausreichen.

Wenn ein Knoten ausfällt, kann das System automatisch den Datenverkehr umleiten, um die Verbindung aufrechtzuerhalten. Dies sorgt für eine höhere Zuverlässigkeit und Stabilität des Netzwerks. Diese Fähigkeit wird auch als automatische Selbstheilungsfunktion bezeichnet.

Durch die Nutzung eines dedizierten Backhaul-Bandes wird die verfügbare Bandbreite für die Endgeräte maximiert. Dies bedeutet, dass das Netzwerk effizienter arbeitet und höhere Geschwindigkeiten bietet, selbst wenn viele Geräte gleichzeitig verbunden sind.

WiFi 6E Fazit

Obwohl WiFi 6E erhebliche Vorteile bietet, wie höhere Geschwindigkeiten, größere Kapazitäten und eine geringere Latenz, ist es wichtig, die Reichweitenbegrenzungen des 6-GHz-Bandes zu berücksichtigen. Diese Einschränkungen resultieren aus der physikalischen Eigenschaft, dass höhere Frequenzen eine kürzere Reichweite und eine geringere Durchdringungsfähigkeit durch Hindernisse wie Wände und Decken haben. Daher erfordert die Implementierung von WiFi 6E eine sorgfältige Planung und Optimierung.

Eine der wichtigsten Überlegungen bei der Implementierung von WiFi 6E ist die strategische Platzierung der Access Points. In großen Gebäuden oder komplexen Wohnräumen reicht es nicht aus, nur einen einzigen Access Point zu verwenden. Stattdessen sollten mehrere Access Points strategisch platziert werden, um eine gleichmäßige Abdeckung sicherzustellen und tote Zonen zu vermeiden. Dies bedeutet oft, dass zusätzliche Hardware erforderlich ist, was die Installationskosten erhöhen kann, aber letztlich für eine zuverlässigere und schnellere Verbindung sorgt.

Ein WLAN-Mesh-System kann eine effektive Lösung sein, um die Reichweitenprobleme von WiFi 6E zu überwinden. Ein Mesh-System besteht aus einem Hauptrouter und mehreren Satelliten oder Knoten, die zusammenarbeiten, um das WLAN-Signal über eine große Fläche zu verteilen. Dies ermöglicht eine nahtlose Konnektivität, selbst wenn sich Benutzer durch verschiedene Räume oder Stockwerke bewegen. Ein Quad-Band-Mesh-System kann besonders vorteilhaft sein, da es ein dediziertes Band für die Kommunikation zwischen den Knoten verwendet und somit die verfügbare Bandbreite für die Endgeräte maximiert.

Ein weiteres wichtiges Konzept ist die effiziente Nutzung der verschiedenen verfügbaren Frequenzbänder. Während das 6-GHz-Band für hohe Datenraten und geringe Latenz optimal ist, bieten das 5-GHz- und das 2,4-GHz-Band eine bessere Reichweite und Durchdringungsfähigkeit. Durch die gleichzeitige Nutzung aller drei Bänder können Netzwerke flexibel auf die Bedürfnisse verschiedener Geräte und Anwendungen reagieren. Ältere Geräte oder solche, die keine hohen Datenraten benötigen, können das 2,4-GHz- oder 5-GHz-Band verwenden, während moderne Geräte, die hohe Bandbreiten erfordern, das 6-GHz-Band nutzen können.

Die kontinuierliche Überwachung und Anpassung des Netzwerks ist entscheidend, um die beste Leistung zu gewährleisten. Dies kann durch regelmäßige Firmware-Updates, Anpassung der Sendeleistung und Optimierung der Kanalnutzung erreicht werden. Auch die Analyse der Netzwerkauslastung und die Anpassung der Netzwerkkonfiguration basierend auf den tatsächlichen Nutzungsmustern sind wichtige Maßnahmen, um die Effizienz und Zuverlässigkeit des Netzwerks zu maximieren. Die Einführung von WiFi 6E markiert einen bedeutenden Fortschritt in der drahtlosen Kommunikationstechnologie und bietet erhebliche Vorteile in Bezug auf Geschwindigkeit und Kapazität.

Dennoch müssen die Reichweitenbegrenzungen des 6-GHz-Bandes bei der Planung und Implementierung berücksichtigt werden. Durch die strategische Platzierung von Access Points, den Einsatz von Mesh-Systemen, die kombinierte Nutzung von 6-GHz-, 5-GHz- und 2,4-GHz-Bändern sowie regelmäßige Netzwerkoptimierung kann eine optimale WLAN-Abdeckung und -Leistung erzielt werden. Mit sorgfältiger Planung und kontinuierlicher Wartung können die Herausforderungen gemeistert und die Vorteile von WiFi 6E voll ausgeschöpft werden, um eine zuverlässige und leistungsfähige drahtlose Konnektivität in verschiedenen Umgebungen zu gewährleisten.

NUTZUNG | HAFTUNG

Trotz sorgfältiger Kontrolle übernehmen wir keine Gewähr für die Richtigkeit und Vollständigkeit der Inhalte.

Produkttest

Sie sind Hersteller von Sicherheitsprodukten, insbesondere von Komponenten für die Videoüberwachungstechnik und möchten, dass Ihre Artikel durch uns getestet und auf CCTV-check vorgestellt werden, dann besuchen Sie unser spezielles Angebot für Hersteller.

Technologie

Sie möchten in der Wissensdatenbank über eine spezielle Technologie berichten und einen Artikel veröffentlichen, dann nehmen Sie bitte über nachfolgenden Link Kontakt mit uns auf.